当前AI应用领域存在两种常见走向:一边是各类概念层出不穷,围绕AI能力渲染出极致自动化的应用前景;另一边是真实落地场景里,大量项目陷入困境,自动化程度提升的同时,系统稳定性、合规风险与维护成本也随之走高,最终因模型幻觉引发业务偏差,或是投入产出不成正比,难以长期运转。

拨开行业喧嚣,回归落地本质,两条经过实践检验的底层逻辑,支撑AI从概念走向实用化部署:

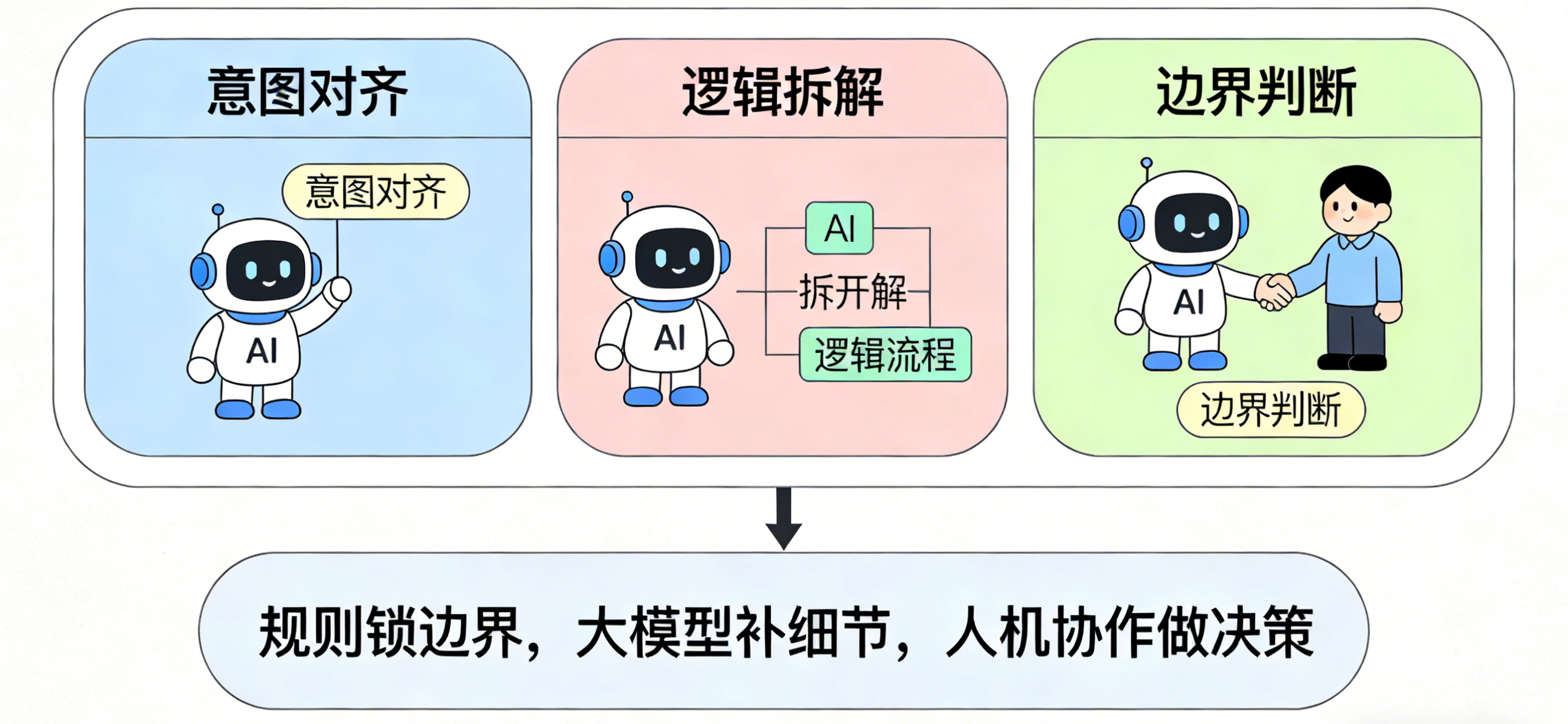

其一,「意图对齐、逻辑拆解、边界判断」的工作,是AI不可替代的核心价值,区别于写代码、调接口、模拟操作这类末端执行动作。

其二,「规则锁边界,大模型补细节,人机协作做决策」,是现阶段AI工业化落地更稳妥的范式,摒弃极端化的应用思路,兼顾效率与可控性。

AI的核心价值是聚焦意图与逻辑的精准把控

部分从业者会陷入窄化认知,把AI的能力等同于机械完成执行类工作,比如撰写代码、调用接口、模拟人机交互,将AI视作单纯的自动化执行工具。这种定位会低估AI的真正价值,忽略决定任务成败的核心环节,工具的使用逻辑,往往比工具本身更能决定最终成效。

代码、接口、自动化脚本,都是任务执行的载体,不代表任务的最终价值。一项数据分析或自动化任务的成效,核心在于输出结果能否贴合真实的业务需求,贴合度决定了产出的实用性。

以常见的用户留存分析为例,业务方提出分析本月用户留存的需求,仅能执行指令的AI,会直接生成一段基础的7日登录留存统计代码,这份结果往往无法贴合实际业务诉求。真实需求或许指向首次消费用户的7日复购留存,需要聚焦华东区域新客群体,剔除大促期间的异常用户数据,同时完成同期数据的横向、纵向对比。

在执行动作启动前,完成真实需求对齐、任务步骤拆解、约束范围划定,这类工作决定了任务的走向与质量,也是AI核心价值所在。AI能辅助理清任务脉络,明确工具选用标准、执行逻辑与风险边界,让后续执行环节贴合需求。

纯大模型端到端闭环,落地存在多重现实壁垒

不少刚接触AI落地的从业者,常会设想全自主AI闭环,让AI独立完成需求理解、脚本编写、定时执行、报错修复、结果迭代的全流程。这类理想化的模式,在商用场景落地时,会遇到难以突破的现实阻碍,这也是由大模型自身特性与商用合规要求共同决定的。

第一,大模型在长上下文、多条件约束场景下,易出现指令跟随能力衰减,引发信息偏差。业务洞察与全链路自动化,需要完成多约束、多步骤的连贯操作,一项指标异常分析,要依次经过数据质量校验、多维度拆解、漏斗归因、业务动作匹配、外部因素排除,全程涉及大量数据与业务规则。这种场景下,大模型容易出现关键信息遗漏、规则偏移,前期明确的口径与约束,在流程推进中可能发生变动,微小的偏差就会让最终结论失真,仅靠提示词优化、模型微调,难以彻底根除这类问题。

第二,大模型易将相关性等同于因果性,难以支撑严谨的业务决策。企业需要的落地洞察,是精准的因果判断,比如销量下滑源于注册流程新增验证步骤,导致新客转化率下降,可针对性调整流程。大模型依托训练数据的语料关联做推理,常会把统计相关性当成业务因果性,得出无实际指导意义的结论,这类内容无法落地执行,还可能带来决策误判,影响业务走向。

第三,纯大模型黑盒输出,难以满足商用合规要求。企业级数据分析与自动化执行,需要全流程可追溯、可审计、可复现,方便后续核查与权责界定。纯大模型端到端输出,推理逻辑缺乏业务层面的可解释性与可审计性,无法保证判断完全贴合固化的业务规则,即便技术上可复现输出,也难以满足合规追责的硬性要求。目前主流的企业级AI平台、数据分析工具,都会搭配固化规则,打造白盒化执行体系,贴合商用合规标准。

AI稳妥落地范式:规则锁边界,大模型补细节,人机协作做决策

AI落地无需走极端,既不用强求全流程无人干预,也不用将AI局限在基础执行层面。搭建一套权责清晰、风险可控的体系,适合规模化复用,也是当前头部企业AI落地的主流思路。

规则锁边界:搭建AI运行的刚性框架

规则是用代码与规则引擎固化的核心逻辑,构成AI系统的基础骨架,划定运行范围与安全底线。规则内容涵盖统一的业务口径、标准化的分析流程、严格的数据校验标准、明确的合规要求,以及异常告警与熔断机制。

开展指标异常分析时,系统会依照固定流程推进,先核查数据质量,再做维度拆解、漏斗归因,最后匹配业务动作,不随意跳过关键步骤。自动化数据采集场景中,会提前划定合规范围、控制采集频率、规范数据存储方式,AI遵循既定参数运行。数据计算环节,锁定企业统一口径,杜绝口径漂移问题。

这套固化的规则体系,能有效约束大模型幻觉、逻辑偏移带来的业务风险,把AI的运行范围锁在可控区间,筑牢工业化落地的根基。

大模型补细节:发挥可控范围内的提效价值

划定运行边界,不限制大模型发挥优势,反而能让AI脱离决策压力,专注于擅长的补位工作,让整套系统更灵活。

在这套框架下,大模型承接多项提效工作:把模糊的自然语言需求,转化为规则内的标准化执行指令,降低工具使用门槛;将规则引擎输出的零散数据,整理成通顺易懂的业务解读,提升结果可读性;填补规则覆盖不到的空白场景,针对无开放API的老旧系统,用浏览器操作完成低频非标任务,针对小众细分场景,省去定制化规则开发,直接完成适配性分析;辅助规则体系优化,从实时数据与人工反馈中提炼规律,生成规则初稿,缩短规则迭代周期。

大模型在落地环节,承担补位角色,不触碰核心决策权,所有输出都依托规则与数据,不做无依据的判断。

人机协作做决策:守住风险与权责底线

无人工干预的全自动运行,仅适合高频、标准化、低风险的小众场景。多数涉及业务判断的商用场景,都会保留人工审核环节。AI可以完成大部分重复性的探索、执行、整理工作,最终的决策、审核与权责界定,交由人工把控。

这种协作模式,既能防控风险,也能实现效率最大化。人工从繁琐的重复劳动中解脱,专注于业务判断、规则优化、战略规划等高价值工作。AI成为人力的延伸,辅助提升工作效率,实现人与AI的优势互补。

AI落地的合理演进:稳健的人机协同闭环

理想化的AI演进思路,是逐步下放全部权限,打造完全自主的运行闭环。结合当下的技术水平与落地经验,现阶段更稳妥、可行性更高的路径,是持续完善规则框架,打磨大模型补位能力,优化人机协作流程,形成良性运转的闭环。

这套闭环的运行逻辑清晰直白:人工制定核心规则,划定需求边界,AI在框架内完成标准化执行;AI依照预设规则核查结果、排查异常,遇到无法解决的问题,及时触发人工介入,不擅自修改核心逻辑;人工审核反馈后,持续优化规则框架,规则体系不断完善,AI的执行效率与准确性也会同步提升。

这是一套人机协同的闭环模式,运行稳定、风险可控,不会出现错误累积、越改越偏的问题,也能守住合规红线,保证投入产出比处于合理区间。

当下AI行业从不缺少新鲜概念,务实的落地思路更显珍贵。聚焦AI的核心价值,做好意图对齐、逻辑拆解、边界判断,让AI精准贴合业务需求。遵循合理的落地范式,用规则把控风险,用AI提升效率,用人机协作守住底线,让AI创造长效、稳定的实用价值,也是AI工业化落地的核心要义。

提示

ai夜话是一个关于ai方向的闲谈整理文章集。因为核心是ai,所以除了原始对话内容(文中不可见😛)是我和友人真人快打出来的,文章全部内容来自于ai整理,因此可以算是ai原生文章。大致过程:真人快打 → ai观点总结 → ai观点评论 → ai整理成文 → ai批评改进 → 人工校对纠错 → ai配图。由于内容来自我、友人以及ai,因此如有错漏,敬请谅解。